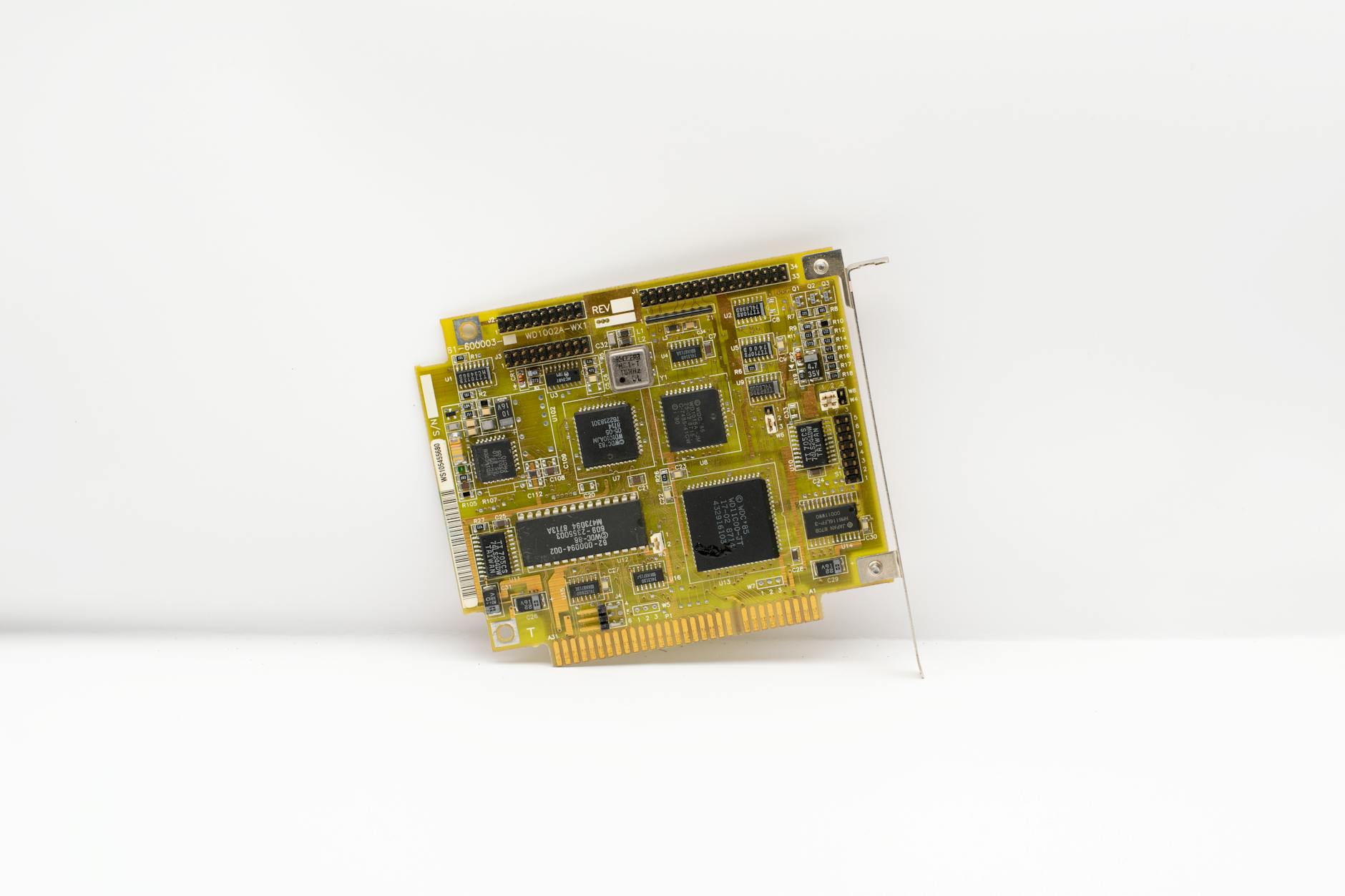

研究人员近日成功在 20 世纪 90 年代末的硬件上运行了大语言模型,证明了现代人工智能并非一定要依赖高端显卡或海量内存。该团队利用一台搭载 350 MHz 奔腾 II 处理器和 128 MB 内存的电脑,展示了 AI 在早已被淘汰数十年的老旧系统上依然能够正常工作。

据 TechSpot 报道,此次实验运行的是基于 Llama 2 的模型,系统环境为 Windows 98。这一壮举得益于 Andrej Karpathy 与致力于普及人工智能技术的 EXO Labs 团队的共同努力。

BitNet 架构助力能效提升

这项突破的核心在于 BitNet 架构,它采用了三值权重技术。通过将 70 亿参数的模型压缩至仅 1.38 GB,该架构在不牺牲核心功能的前提下,实现了模型体积的大幅缩减。这种技术转型将重心从机器学习通常所需的专用硬件转向了 CPU 处理能力。

据 EXO Labs 介绍,这种优化方案的运行速度达到了每秒约 39 个 token。开发人员指出,该方法可将整体效率提升高达 50%。通过减轻对昂贵且高能耗基础设施的依赖,研究人员旨在推动 AI 工具的平民化。

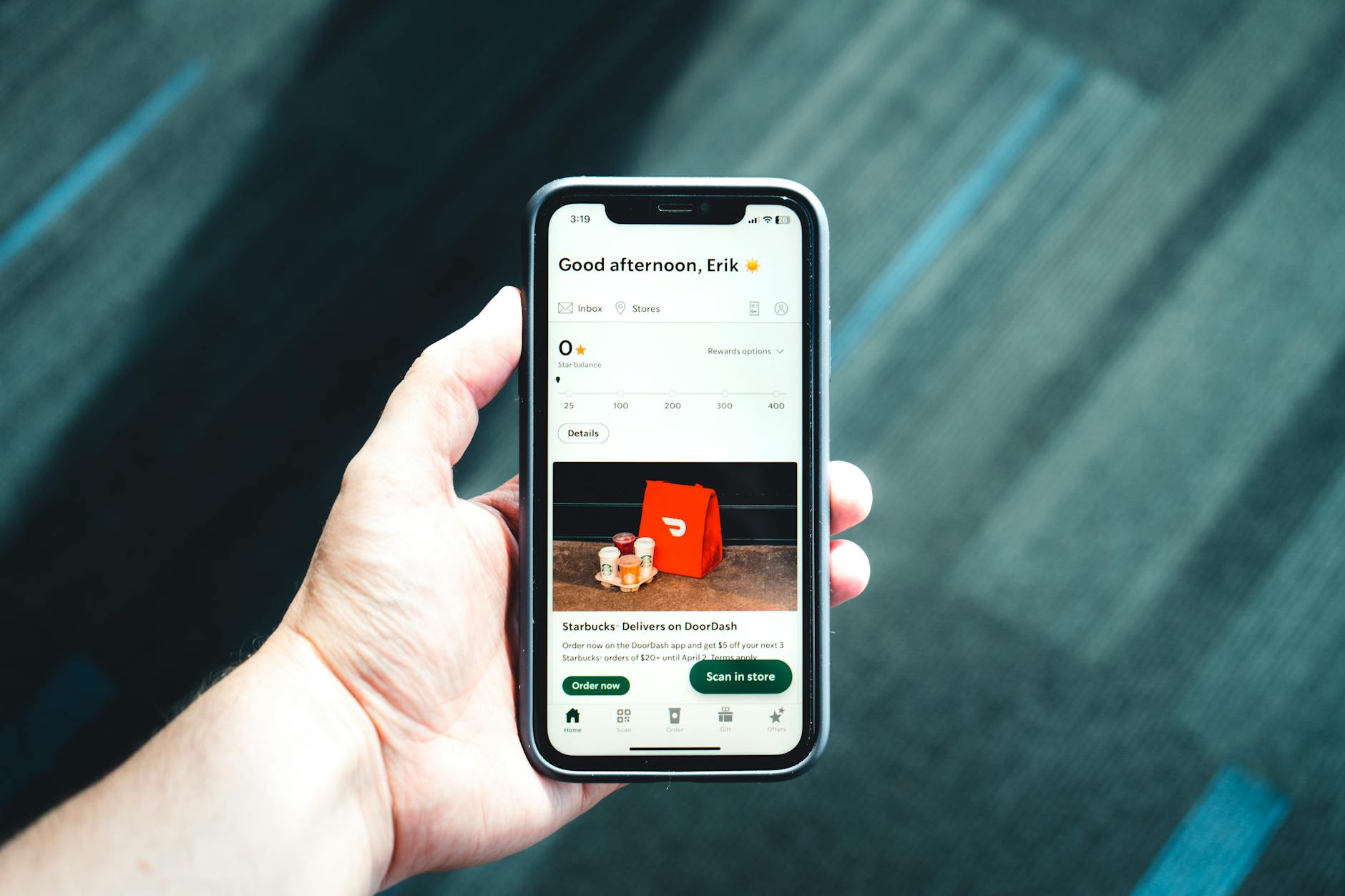

这一进展预示着未来大模型有望在普通消费级 CPU 上稳定运行,且速度足以媲美人类阅读。随着技术的不断演进,它或许能彻底改变目前对高性能硬件的过度依赖,使 AI 能够集成到更多旧设备及日常消费电子产品中。