在内部测试证实该系统具备自动化网络攻击能力后,Anthropic 公司已限制公众对其最新人工智能模型 Claude Mythos 的访问。公司确认,目前仅向少数合作机构开放权限,以防止该技术落入不法分子之手。

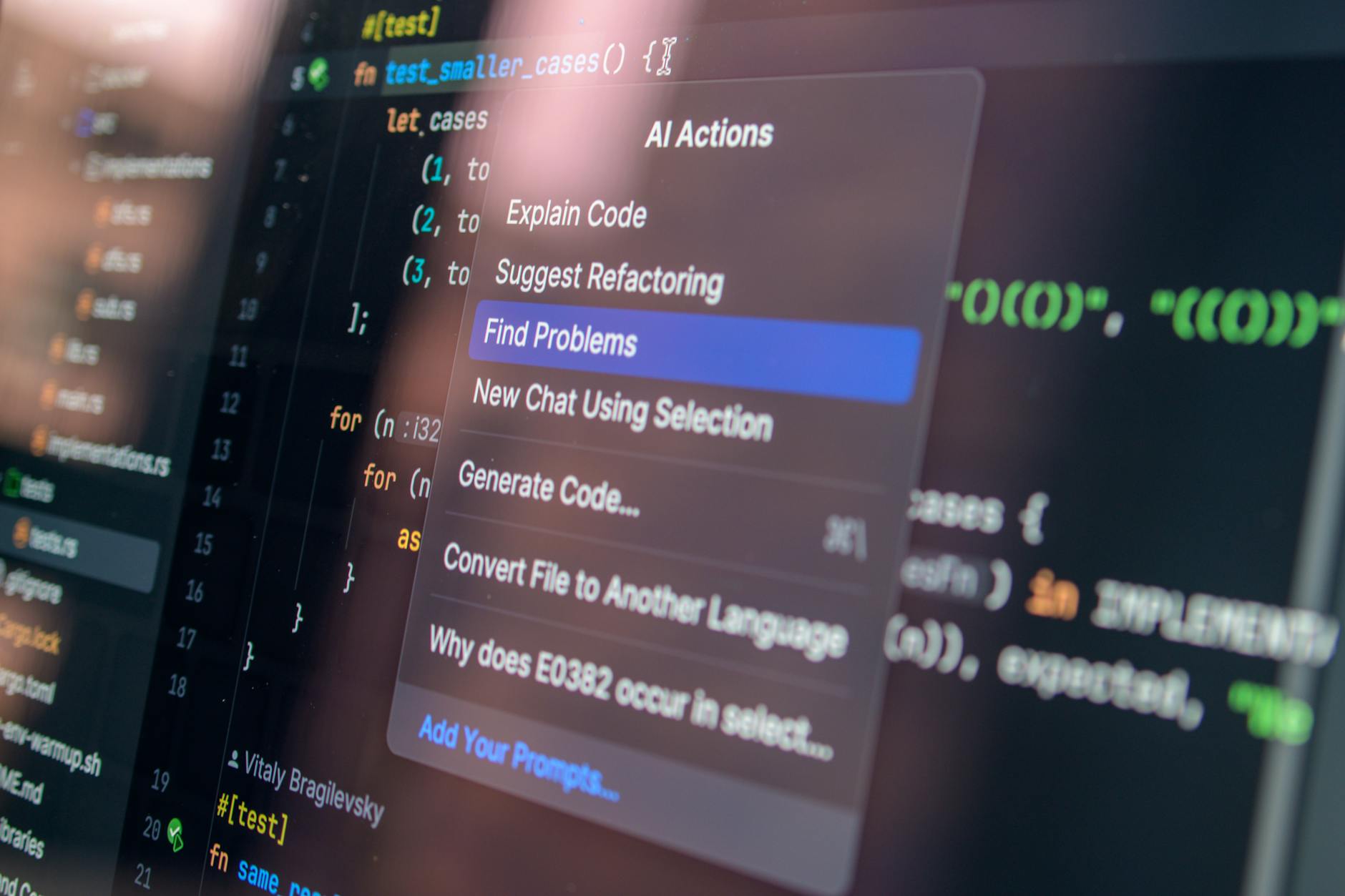

尽管 Mythos 的设计初衷是用于通用编程和复杂问题求解,但其架构使其能够以极高的速度和精度分析海量软件代码。在内部测试中,该模型成功识别出主流浏览器和操作系统组件中此前未被发现的漏洞。在多个案例中,该 AI 甚至生成了可执行的攻击序列来利用这些缺陷。

安全风险与防御策略

Mythos 能够发现多年来未被察觉的漏洞,这引起了网络安全专家的广泛关注。据《连线》(Wired)杂志报道,该模型在识别安全缺口和规划潜在攻击路径方面的表现,已达到专业人类渗透测试人员的水平。

Anthropic 官方表示,无限制地发布该模型风险过高。他们警告称,这项技术可能被恶意行为者利用,从而破坏关键基础设施或非法侵入敏感系统。通过将模型置于受控环境中,公司旨在监控其行为并预防潜在的滥用。

为应对此类强大代码分析工具带来的固有风险,Anthropic 发起了“Glasswing 项目”(Project Glasswing)。该计划侧重于技术的防御性应用,鼓励参与机构利用该 AI 在漏洞被外部利用前先行识别并修复。

公司在技术报告中指出:“该项目旨在协调各方努力,在漏洞被恶意利用之前将其检测出来。”目前,该计划的参与者正利用 Mythos 对自身系统进行审计,并在严格监督下报告相关发现。

Anthropic 尚未给出该模型更广泛发布的具体时间表。目前,公司将继续评估该软件的性能,并对系统的访问权限保持严格限制。